Askeri yapay zekanın etik bir şekilde kullanılması mümkün mü ?

6 Mart 2026

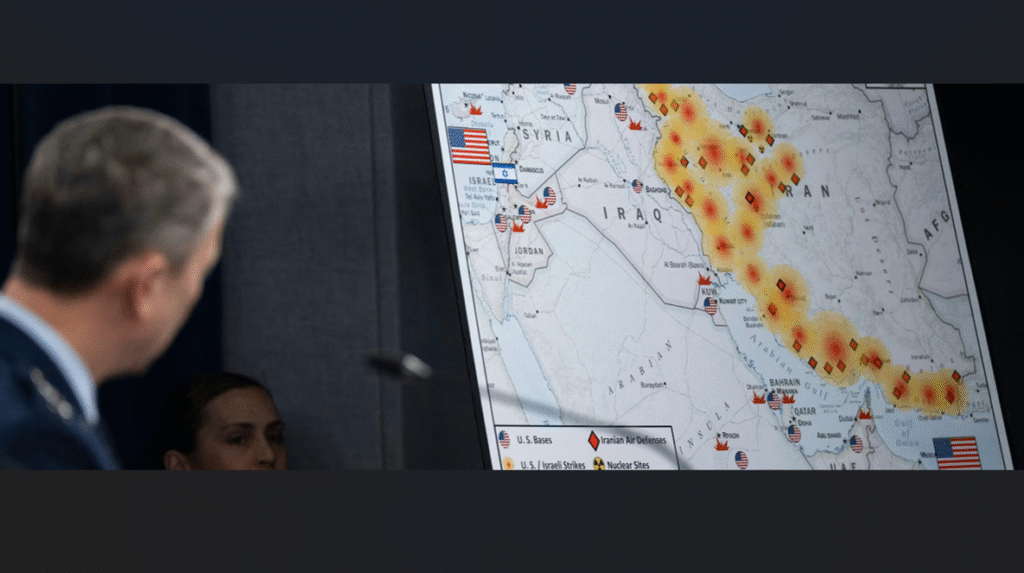

ABD ve İsrail’in İran’daki tesislere yönelik büyük çaplı saldırılarını başlatmasından sadece birkaç saat önce, Pentagon’da önemli bir gelişme yaşandı: ABD Başkanı Donald Trump, Savunma Bakanlığı’nın, Claude adlı sohbet robotunun üreticisi Anthropic tarafından sağlanan yapay zekâ teknolojisinin kullanımını aşamalı olarak sonlandıracağını duyurdu. Uzun süredir devam eden tartışma, ABD ordusunun otonom silahlarda ve vatandaşların kitlesel gözetiminde yapay zekâ teknolojisinin kullanımına getirilen sınırlamalar üzerineydi.

Deakin Üniversitesi’nde uluslararası ilişkiler öğretim üyesi olan Bianca Baggiarini, bu gelişmeyi etik ve askeri açıdan inceliyor. Sadece birkaç yıl öncesine kadar, hükümetler ve teknoloji şirketleri arasında otonom silahların oluşturduğu riskler konusunda küresel olarak bir fikir birliği oluştuğunu belirtiyor. Ayrıca, ordunun yapay zekâ kullanımı konusunda normlar oluşturmada da ilerleme kaydedilmişti. Ancak bunun hızla değişmekte olduğunu söylüyor.”Kaçınılması zor bir sonuç şu ki, eğer askeri yapay zekanın etik bir şekilde – şeffaf kurallar ve yasalar çerçevesinde – kullanılmasını istiyorsak, güçlü demokratik normlara ihtiyacımız var; ancak kurallara dayalı uluslararası düzenin çökmeye başlamasıyla bu normlar tehlikeye giriyor,” diye yazıyor.