Yapay zeka’nın askeri kullanımı istifa getirdi

OpenAI’nin Robotik Şefi, Şirketin Pentagon ile Anlaşmasının Ardından İstifa Etti

07 Mart 2026,

Özet

OpenAI’da Pentagon ile yürütülen yapay zeka iş birliği şirket içinde tartışma yarattı. Robotik biriminin başındaki Caitlin Kalinowski, etik kaygılarını gerekçe göstererek görevinden ayrıldığını açıkladı. İstifa, teknoloji şirketlerinde savunma projelerine yönelik tartışmaları yeniden gündeme taşıdı.

OpenAI’de donanım ve robotik mühendisliği ekip lideri olan Caitlin Kalinowski, Cumartesi günü yaptığı açıklamada, OpenAI CEO’su Sam Altman’ın Savunma Bakanlığı ile askeri operasyonlarda teknolojilerini kullanmak üzere bir anlaşma yapmasının ardından şirketten ayrıldığını ve bu kararının “ilkesel bir karar” olduğunu sosyal medya paylaşımında belirtti.

OpenAI’nin bir ekip lideri, Savunma Bakanlığı ile yapılan anlaşmanın duyurulmasının ardından şirketten ayrıldığını Cumartesi günü açıkladı.

Önemli Bilgiler

2024 yılında Meta’dan işe alınan Kalinowski, X’te yaptığı açıklamada kararının kolay olmadığını söyledi: “Yapay zekanın ulusal güvenlikte önemli bir rolü var. Ancak yargı denetimi olmadan Amerikalıların gözetlenmesi ve insan izni olmadan ölümcül özerklik, hak ettiklerinden daha az dikkate alındı.

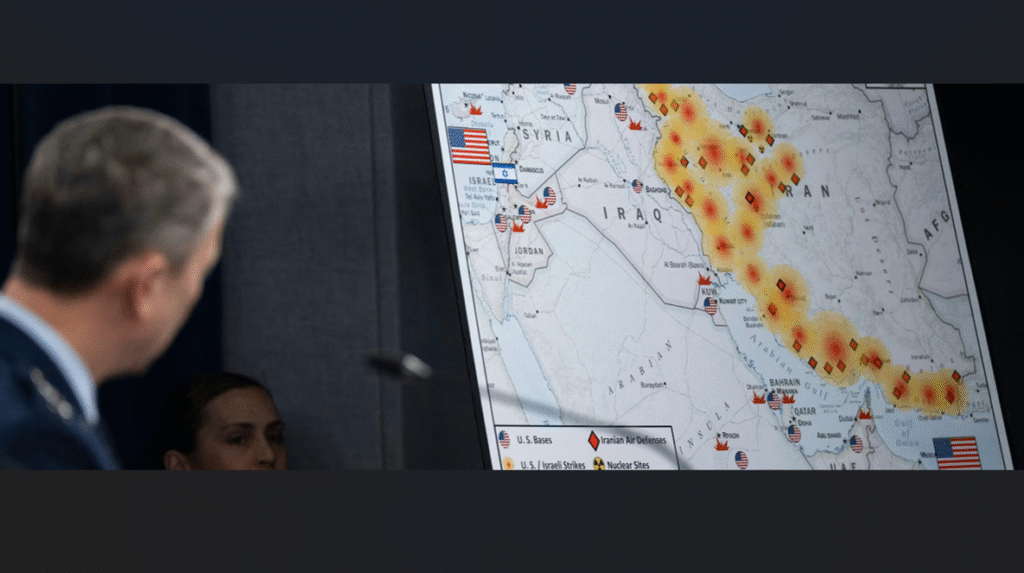

İstifa Kararı, OpenAI’nin bu hafta teknolojisinin siber güvenlik, istihbarat analizi ve lojistik gibi savunma ile ilgili çalışmaları destekleyebileceğini açıklamasının ardından geldi; bu alanlar ordunun yapay zeka için kritik uygulamalar olarak gördüğü alanlardır.

Anlaşma, yapay zekanın askeri operasyonlara genişletilmesinin gözetim ve otonom silahlar konusunda riskleri artırdığı konusunda uyarıda bulunan bazı OpenAI çalışanları ve yapay zeka araştırmacılarından eleştiri aldı.OpenAI ve Savunma Bakanlığı arasındaki ortaklık, Trump yönetiminin Pentagon’un resmi olarak tedarik zinciri riski olarak nitelendirdiği Anthropic ile çalışmaktan vazgeçmesinin ardından geldi.

Kalinowski, X’te OpenAI’nin duyurusuyla ilgili sorununun aceleye getirilmiş olması olduğunu ve “tanımlanmış güvenlik önlemleri olmadan” yapıldığını yazdı.

Önemli Alıntı

OpenAI, Kalinowski’nin istifasını doğrulayan Tech Crunch’a yaptığı açıklamada, “Pentagon ile yaptığımız anlaşmanın, kırmızı çizgilerimizi netleştirirken yapay zekanın sorumlu ulusal güvenlik kullanımları için uygulanabilir bir yol oluşturduğuna inanıyoruz: iç gözetim yok ve otonom silah yok” dedi. “İnsanların bu konularda güçlü görüşlere sahip olduğunun farkındayız ve dünya genelindeki çalışanlar, hükümet, sivil toplum ve topluluklarla görüşmeye devam edeceğiz.”

ChatGPT Tepkilerle Karşı Karşıya

Tartışma, popüler yapay zeka uygulaması ChatGPT’nin kullanıcıları arasında büyük bir tepkiye yol açtı ve kullanıcılar uygulamayı dalgalar halinde sildi. Tech Crunch, Savunma Bakanlığı ile yapılan anlaşmanın duyurulmasının ertesi günü ChatGPT’nin mobil uygulamasının kaldırılma oranının %295 arttığını bildirdi. Buna karşılık Altman, anlaşmanın “aceleyle yapıldığını” ve “fırsatçı ve özensiz” göründüğünü yazdı. Anlaşma değiştirildi ve şimdi ChatGPT destekli sistemlerin “ABD vatandaşlarının ve kişilerinin iç gözetimi için kasıtlı olarak kullanılmayacağını” belirtiyor. ChatGPT’nin kaldırılması, Anthropic’in Claude uygulamasının indirilme oranındaki artışla aynı zamana denk geldi; bu uygulama 2 Mart itibariyle haftalık bazda yaklaşık %55 artış gösterdi.

Temel Arka Plan

Pentagon, başlangıçta Anthropic ile çalıştı; şirket, yapay zekayı askeri planlamaya dahil etme çabalarının bir parçası olarak, modellerinin hükümet tarafından nasıl kullanıldığı konusunda sıkı güvenlik önlemleri almak istiyor. Ancak Trump yönetimi, Claude geliştiricisi Anthropic’in yapay zeka teknolojisinin ordu tarafından otonom silahlar veya kitlesel gözetim için kullanılmasına izin vermeyeceği gerekçesiyle Anthropic ile olan sözleşmesini iptal etti. Bu değişiklik, OpenAI’nin Savunma Bakanlığı ile ilişkisini derinleştirmesinin önünü açtı; şirket, Anthropic, Google ve xAI ile birlikte geçen Haziran ayında ulusal güvenlik amaçlı yapay zeka araçları geliştirmek için Pentagon ile 200 milyon dolarlık bir sözleşme imzalamıştı.

Eski Anthropic Lideri Dünyanın ‘Tehlikede’ Olduğu Konusunda Uyarıda Bulundu

Pentagon ile Anthropic arasındaki anlaşmazlık, şirketin kendi içinde de yaşandı. Şubat ayında, Anthropic’in güvenlik araştırmaları lideri Mrinank Sharma, istifa mektubunda yapay zekâya bağlı artan riskler ve küresel güvenlik sorunları nedeniyle “dünyanın tehlikede” olduğu uyarısında bulunarak şirketten ayrıldığını duyurdu. Sharma, şirketler güçlü yapay zekâ sistemlerini devreye sokmak için yarışırken güvenlik ekiplerinin giderek daha fazla baskı altında olduğunu söyledi. Bu ayrılık, şirketleri geliştirme sürecini yavaşlatmaya veya teknolojinin nasıl kullanıldığına dair daha katı kurallar getirmeye çağıran yapay zekâ araştırmacılarının bir dizi uyarısına eklendi.

Kaynak: Mike Stunson,https://www.forbes.com/sites/mikestunson/2026/03/07/openais-robotics-chief-leaving-tech-company-after-its-deal-with-pentagon/